KI-Untertitel und Barrierefreiheit: Warum automatische Captions nicht reichen

Künstliche Intelligenz war 2022 noch ein heiß diskutiertes Zukunftsthema. Heute ist sie längst Alltag geworden — auch in der Video- und Contentproduktion. Automatische Untertitel erscheinen inzwischen fast überall: auf TikTok, Instagram, LinkedIn oder YouTube. Was vor wenigen Jahren noch nach futuristischer Technologie klang, gehört heute zum Standard moderner Apps.

Als ich diesen Artikel ursprünglich geschrieben habe, nutzte ich KI-Spracherkennung bereits täglich für Transkriptionen und Video-Untertitelungen. Damals faszinierte mich vor allem, wie viel Zeit sich dadurch sparen ließ. Heute sehe ich das Thema differenzierter. Denn die eigentliche Frage lautet längst nicht mehr: Kann KI Untertitel erstellen? Sondern: Wie gut sind diese Untertitel wirklich?

Automatische Captions sind schnell erstellt — aber noch lange nicht automatisch professionell, verständlich oder barrierefrei. Viele der Probleme, die ich damals bei automatisch generierten Untertiteln beobachtet habe, begegnen mir auch heute noch täglich: fehlende Groß- und Kleinschreibung, falsche Namen, schlechte Segmentierung, unlesbare Gestaltung oder Untertitel, die zwar technisch vorhanden sind, aber kaum jemand wirklich gut lesen kann.

Gleichzeitig haben sich meine eigenen Anforderungen verändert. Heute interessieren mich nicht nur Geschwindigkeit und Automatisierung, sondern vor allem Qualität, Sprachkontrolle, strukturierte Workflows, Datenschutz und digitale Barrierefreiheit. Und genau darum geht es in diesem aktualisierten Artikel: um KI-Spracherkennung, automatische Untertitel, professionelle Workflows — und die Frage, warum menschliche Qualitätskontrolle trotz KI wichtiger geworden ist als je zuvor.

Mein allererstes Mal: Spracherkennung 1.0

Meine erste Begegnung mit Spracherkennung liegt allerdings noch viel länger zurück — in eine Zeit, in der Sprachsteuerung noch wie Science-Fiction wirkte und Handys vor allem eines konnten: telefonieren.

Damals saß ich im Auto neben dem Mann meiner Cousine, einem waschechten Sachsen aus Freital. Plötzlich hörte ich, wie er im breitesten Sächsisch ein einziges Wort ins Mikrofon sagte: „Schwiegermutter.“ Und tatsächlich: Das Handy wählte die Nummer seiner Schwiegermutter.

Ich war beeindruckt. Nicht nur wegen der Technik — sondern auch, weil das Gerät offenbar problemlos Sächsisch verstand. Aus heutiger Sicht wirkt das unspektakulär. Doch vor über 20 Jahren war das tatsächlich eine kleine Sensation. Das Mobiltelefon war damals noch kein smarter Alleskönner wie heute. Sein Handy war ein Siemens S40 mit integrierter Voice-Dialing-Funktion. Bestimmten Kontakten konnte ein Sprachbefehl zugewiesen werden, um sie später per Sprache anzurufen.

Der Haken: Das Gerät verstand praktisch nur ihn selbst — inklusive seines sächsischen Dialekts. Ich hätte mit meinem Hochdeutsch vermutlich keinen einzigen Anruf auslösen können. Technisch handelte es sich um eine sogenannte sprecherabhängige Spracherkennung. Das System musste zunächst auf die Stimme und Aussprache der jeweiligen Person trainiert werden.

Heute wirken solche Einschränkungen fast nostalgisch. Denn moderne KI-Systeme wie Siri, Alexa oder automatische Untertitelungs-Tools verstehen längst Millionen unterschiedliche Stimmen, Akzente und Sprachmuster — zumindest meistens. Und genau dort beginnt das eigentliche Spannungsfeld moderner KI-Spracherkennung: Sie ist beeindruckend schnell geworden. Aber nicht automatisch präzise.

Von Siri und Alexa zu automatischen Untertiteln

Mit digitalen Sprachassistenten wie Siri, Alexa oder Google Assistant wurde Spracherkennung schließlich massentauglich. Plötzlich sprach nicht mehr nur ein Technik-Nerd mit seinem Handy — sondern Millionen Menschen mit ihren Smartphones, Lautsprechern oder Smartwatches. Heute fragen wir selbstverständlich: „Wie wird das Wetter heute?“, „Spiel meine Playlist.“ oder „Stell einen Timer für zehn Minuten.“

Die Technologie dahinter ist inzwischen beeindruckend leistungsfähig geworden. Moderne Systeme müssen nicht mehr auf einzelne Stimmen trainiert werden, sondern erkennen Sprache weitgehend sprecherunabhängig — inklusive vieler Dialekte, Akzente und Sprachmuster. Zumindest in der Theorie.

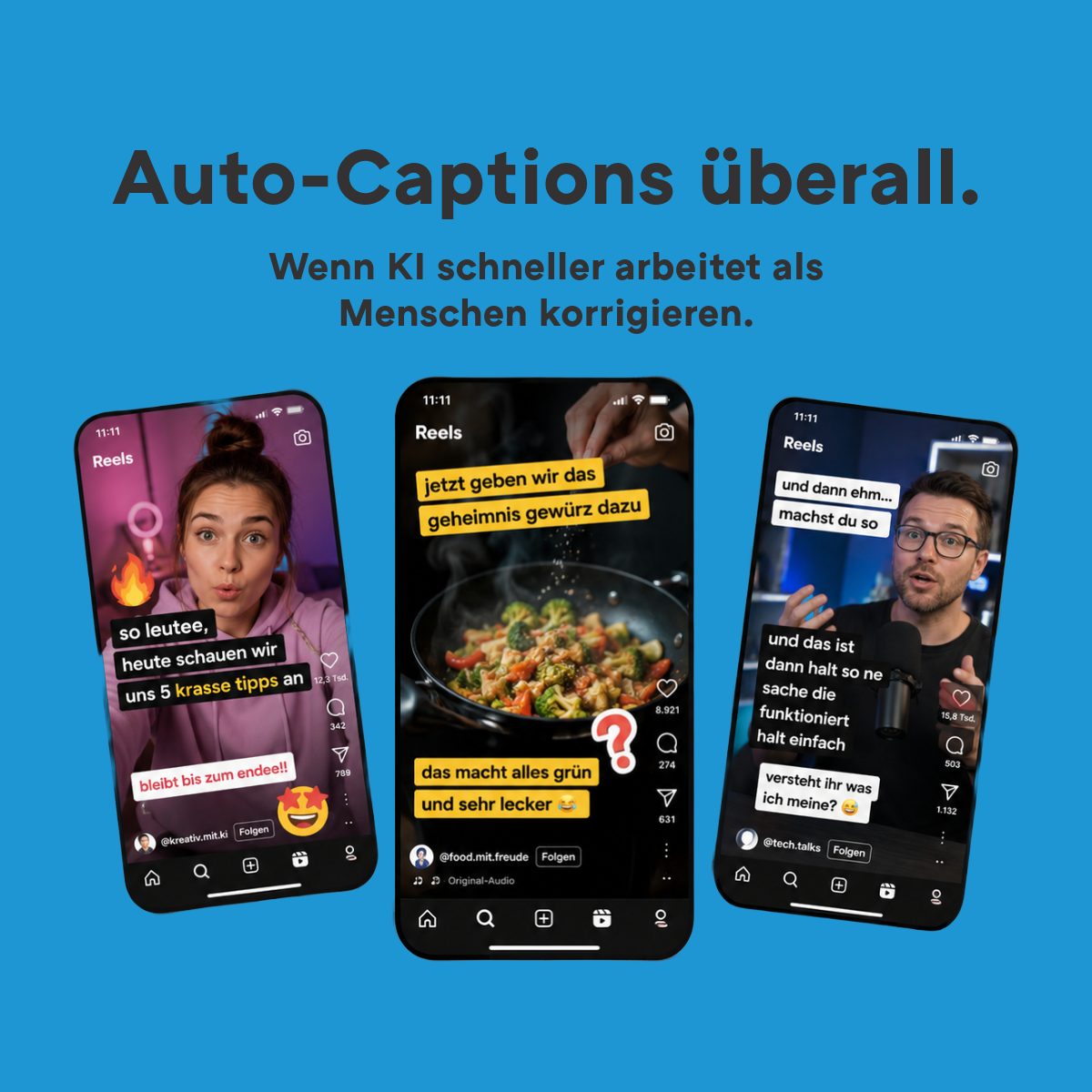

Denn obwohl KI-Spracherkennung enorme Fortschritte gemacht hat, stößt sie im Alltag noch immer an ihre Grenzen: bei Hintergrundgeräuschen, undeutlicher Aussprache, Fachbegriffen, mehreren Sprecher:innen oder spontaner Umgangssprache. Besonders sichtbar wird das heute bei automatisch generierten Untertiteln. Denn dort begegnet uns KI-Spracherkennung inzwischen täglich — auf TikTok, Instagram, LinkedIn oder YouTube. Oft so selbstverständlich, dass viele gar nicht mehr darüber nachdenken, wie viel Technologie eigentlich dahintersteckt.

Warum Untertitel heute wichtiger sind denn je

Videos gehören heute für viele Unternehmen, Selbstständige und Content Creator längst zum digitalen Alltag. Ob LinkedIn-Video, Instagram-Reel, TikTok, YouTube-Short oder Onlinekurs — gesprochenes Wort ist zu einem der wichtigsten Formate im Internet geworden. Und mit dieser Entwicklung sind auch Untertitel praktisch überall angekommen.

Das hat gute Gründe. Untertitel helfen nicht nur gehörlosen Menschen, sondern auch Nicht-Muttersprachler:innen, Menschen in lauten Umgebungen, Smartphone-Nutzer:innen ohne Kopfhörer oder allen, die Inhalte lieber lesen als hören. Außerdem erhöhen Untertitel die Sichtbarkeit von Inhalten, verbessern die Verständlichkeit und machen Videos leichter zugänglich.

Noch vor wenigen Jahren war die Erstellung von Untertiteln allerdings mühsame Handarbeit. Videos mussten vollständig angesehen und gesprochene Inhalte manuell transkribiert werden — ein zeitaufwändiger Prozess, besonders bei längeren Aufnahmen. Heute übernehmen KI-Systeme diesen Schritt in wenigen Sekunden.

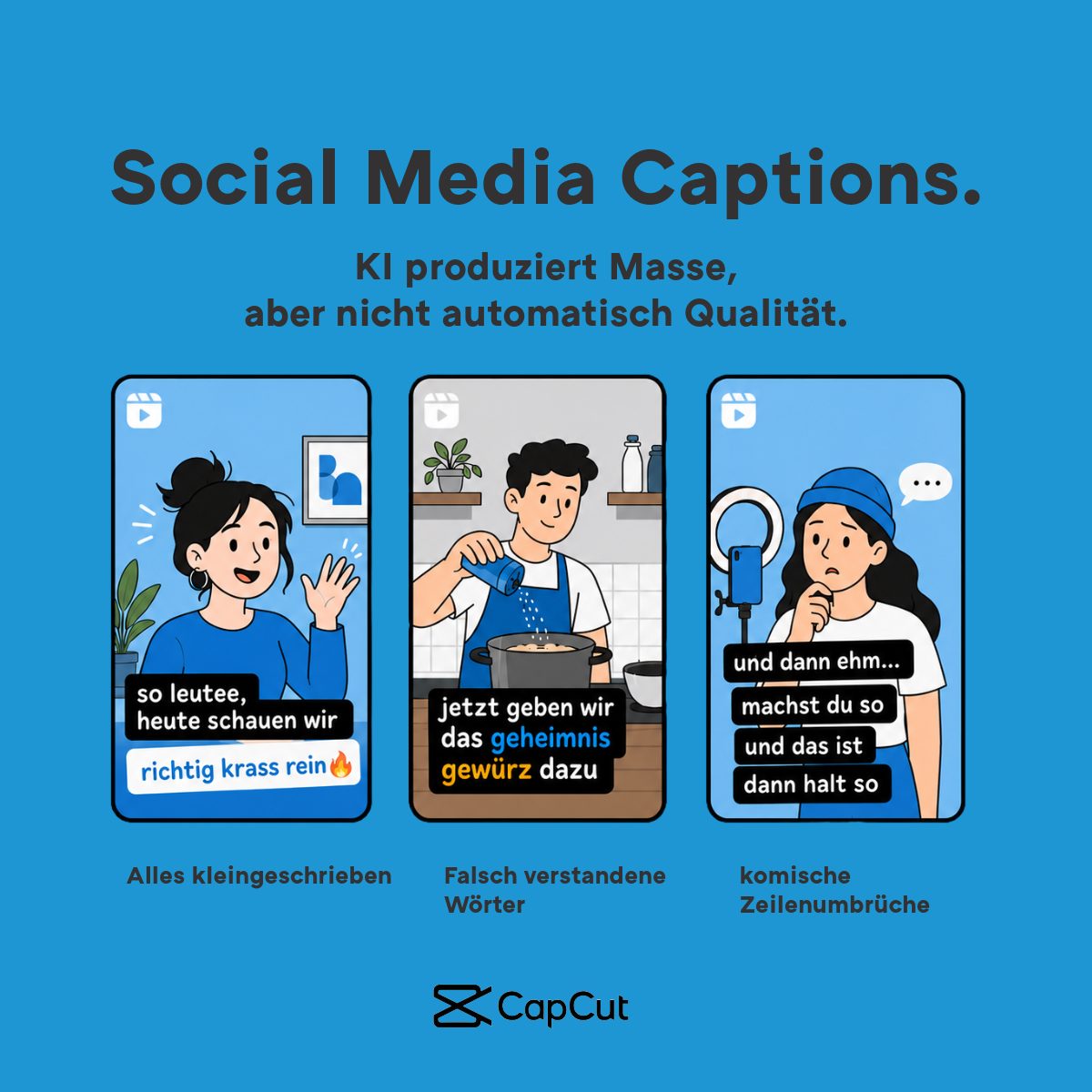

Nahezu jede Social-Media-App bietet inzwischen automatische Untertitel an. Besonders beliebt sind Tools wie CapCut, die Untertitel direkt per KI erzeugen und gleichzeitig visuell für Social Media aufbereiten können. Doch genau hier beginnt auch ein Problem, das mir in den letzten Jahren immer häufiger begegnet: Automatisch generierte Untertitel werden oft veröffentlicht, ohne überhaupt noch überprüft zu werden.

CapCut: Schnell, beliebt und voller Effekte

Ein besonders populäres Tool für automatische Untertitel ist CapCut. Die App gehört zu den bekanntesten Video-Editoren für TikTok-Videos, Instagram-Reels und andere Social-Media-Formate — nicht zuletzt, weil sie viele KI-Funktionen sehr einfach zugänglich macht.

Untertitel lassen sich dort mit wenigen Klicks erzeugen: Video hochladen, „Automatische Untertitel“ auswählen, Sprache festlegen — und kurze Zeit später erscheint der gesprochene Text direkt in der Timeline. Gerade für schnelle Social-Media-Produktionen ist das unglaublich praktisch. Und genau darin liegt auch die große Stärke moderner KI-Tools: Sie senken die technische Hürde enorm.

Heute kann praktisch jede:r innerhalb weniger Minuten Videos schneiden, Untertitel generieren, Texte animieren und Inhalte veröffentlichen — ganz ohne klassische Video- oder Schnittkenntnisse. Allerdings zeigt sich bei automatisch erzeugten Untertiteln auch schnell die Kehrseite der Automatisierung.

Denn obwohl die KI Sprache mittlerweile erstaunlich gut erkennt, entstehen im Deutschen nach wie vor viele Fehler: fehlende Groß- und Kleinschreibung, falsche Namen, fehlerhafte Zeichensetzung, merkwürdige Satzumbrüche oder Begriffe, die komplett falsch verstanden werden. Besonders problematisch wird das, wenn Untertitel ungeprüft veröffentlicht werden. Denn viele Zuschauer:innen bemerken sofort, wenn Untertitel unnatürlich wirken oder voller Fehler sind. Und gerade bei professionellen Inhalten kann das schnell unruhig, unpräzise oder wenig vertrauenswürdig wirken.

Hinzu kommt: Automatisch generierte Untertitel sind nicht automatisch barrierefrei. Denn gute Untertitel bestehen nicht nur aus erkanntem Text. Entscheidend sind auch sinnvolle Segmentierung, Lesegeschwindigkeit, ausreichender Kontrast, klare Sprecherwechsel, gutes Timing und sprachliche Verständlichkeit. Viele KI-Tools optimieren Untertitel heute vor allem für Aufmerksamkeit und Geschwindigkeit — nicht unbedingt für Lesbarkeit oder digitale Barrierefreiheit.

CapCut und Datenschutz: Warum kostenlose KI-Tools nicht kostenlos sind

Seit der ursprünglichen Veröffentlichung dieses Artikels hat sich die Diskussion rund um KI-Tools und Datenschutz deutlich verschärft — insbesondere bei Plattformen wie CapCut. Während viele Nutzer:innen CapCut vor allem als praktisches Kreativtool wahrnehmen, stehen die App, ihre Datenverarbeitung und ihre Nutzungsbedingungen immer wieder in der Kritik.

Besonders diskutiert wurden 2025 Änderungen beziehungsweise Klarstellungen der Nutzungsbedingungen. In den CapCut Terms of Service ist geregelt, dass Nutzer:innen dem Anbieter und verbundenen Dritten eine weitreichende Lizenz an hochgeladenen Inhalten einräumen. Dazu gehören unter anderem Rechte zur Nutzung, Bearbeitung, Speicherung, Veröffentlichung, Übertragung und Verbreitung von User Content, soweit dies für die Bereitstellung der Dienste beschrieben wird. CapCut selbst betont, Nutzer:innen behielten ihre Rechte und die Plattform beanspruche kein Eigentum an den Werken. Genau diese juristische Spannung zeigt aber, warum professionelle Nutzer:innen solche Bedingungen genau lesen sollten.

Kritisch diskutiert werden vor allem die weitreichende Lizenzierung hochgeladener Inhalte, die Verarbeitung von Video-, Bild- und Audiodaten, mögliche Datenübertragungen außerhalb der EU sowie die Frage, wie transparent Anbieter erklären, was mit hochgeladenem Material geschieht. Gerade für Unternehmen, Agenturen oder professionelle Kreative kann das problematisch sein — insbesondere dann, wenn mit Kundenmaterial, sensiblen Daten, unveröffentlichten Kampagnen oder personenbezogenen Inhalten gearbeitet wird.

Hinzu kommt ein kultureller Wandel, den ich zunehmend beobachte: Viele KI-Tools werden heute wie harmlose Kreativ-Spielzeuge genutzt, obwohl sie in Wirklichkeit komplexe Plattformen mit umfangreicher Datenerfassung und weitreichenden Nutzungsbedingungen sind. Das bedeutet nicht automatisch, dass man solche Tools grundsätzlich meiden muss. Aber es bedeutet, dass man bewusster entscheiden sollte, welche Inhalte man hochlädt, welche Rechte man einräumt und welche Rolle Datenschutz im eigenen Workflow spielt.

Denn gerade im professionellen Umfeld geht es längst nicht mehr nur um schnelle Ergebnisse — sondern auch um Verantwortung, Qualität und Kontrolle über die eigenen Inhalte.

Was professionelle Untertitelungs-Workflows von Social-Media-Captions unterscheidet

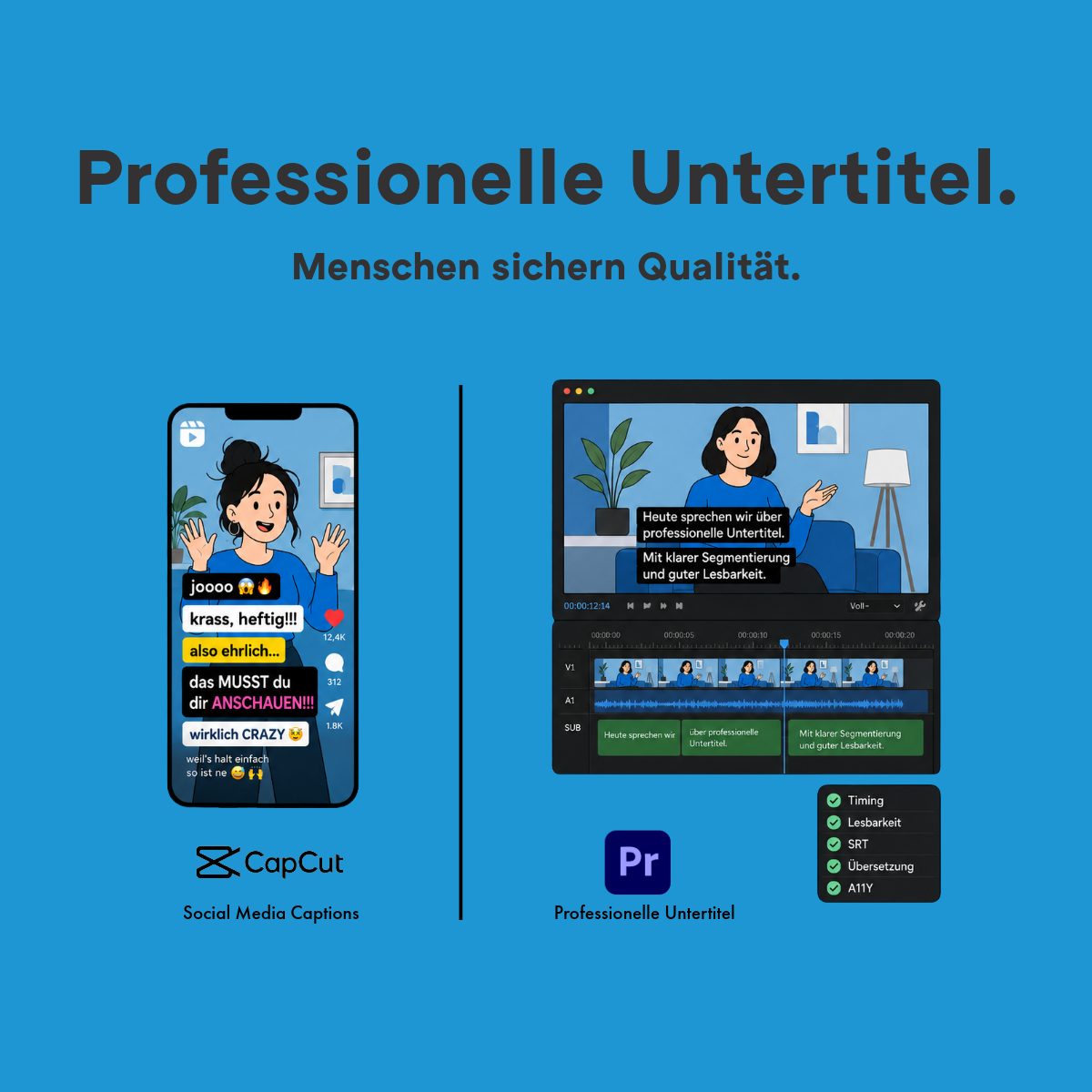

Viele moderne Social-Media-Apps setzen heute vor allem auf Geschwindigkeit, Effekte und maximale Aufmerksamkeit. Untertitel werden dort nicht primär als sprachliches oder barrierefreies Element verstanden, sondern als Teil des visuellen Contents: mit Animationen, Emojis, dynamischen Zooms, Farbwechseln und möglichst viel Bewegung auf dem Bildschirm.

Das funktioniert oft gut für Reichweite und kurze Aufmerksamkeitsspannen. Für professionelle Untertitelungs-Workflows gelten jedoch andere Anforderungen. Denn dort stehen nicht Effekte, sondern Verständlichkeit, Lesbarkeit, sprachliche Qualität und Kontrolle im Mittelpunkt.

Gerade bei längeren Videos, Interviews, Schulungen, Tutorials, mehrsprachigen Projekten oder barrierefreien Inhalten reicht es nicht aus, dass Untertitel lediglich „gut aussehen“. Sie müssen sprachlich korrekt, sauber segmentiert, gut lesbar, zeitlich präzise und technisch zuverlässig sein.

Hinzu kommt: Professionelle Untertitel sind oft Teil eines größeren Publishing- oder Übersetzungsworkflows. Untertitel werden exportiert, übersetzt, korrigiert, versioniert und für unterschiedliche Plattformen angepasst. Dabei spielen Formate wie SRT-Dateien, Timing, Sprachkonsistenz und strukturierte Prozesse eine wichtige Rolle.

Genau deshalb arbeite ich für professionelle Projekte weiterhin lieber mit Adobe Premiere Pro. Nicht, weil dort alles automatisch besser wäre. Sondern weil mir professionelle Tools mehr Kontrolle über Sprache, Qualität und Workflow geben — und genau das wird im Zeitalter von KI für mich immer wichtiger.

Warum ich für professionelle Untertitel weiterhin mit Adobe Premiere Pro arbeite

Als Multilingual-Publishing- und Accessibility-Spezialistin arbeite ich bei professionellen Transkriptionen und Untertitelungen mit Adobe Premiere Pro. Die Funktion „Speech to Text“ beziehungsweise „Sprache in Text“ ist direkt in Premiere Pro integriert und ermöglicht es, aus gesprochenem Dialog automatisch Transkripte zu erstellen und daraus Untertitel zu generieren.

Für mich ist dabei nicht entscheidend, dass die KI perfekt ist. Das ist sie nicht. Entscheidend ist, dass ich mit einem professionellen Tool sauber weiterarbeiten kann. Ich kann Transkripte prüfen, Textstellen suchen, Untertitel zusammenführen oder trennen, Timing anpassen, Untertitel gestalten und verschiedene Ausgabeformate erstellen. Genau diese Kontrollmöglichkeiten sind im professionellen Alltag wichtig.

Denn KI kann eine Rohfassung liefern. Aber die Verantwortung für Qualität liegt weiterhin beim Menschen.

Mein Workflow: Von der Transkription zur übersetzten Untertiteldatei

Für deutschsprachige Videos lasse ich zunächst ein Transkript erstellen. Dieses prüfe ich anschließend sorgfältig auf Fehler. Dabei achte ich nicht nur auf falsch erkannte Wörter, sondern auch auf Namen, Fachbegriffe, Satzzeichen, sinnvolle Satzgrenzen und Lesbarkeit.

Gerade bei Fachthemen kann die Nachbearbeitung schnell mehr sein als ein reines Korrektorat. Wenn viele Anglizismen, Produktnamen, Fachbegriffe oder ungewöhnliche Wörter vorkommen, muss ich oft recherchieren und das Gesagte in den richtigen Kontext setzen.

Aus dem geprüften Transkript erstelle ich anschließend Untertitel. Bei mehrsprachigen Projekten exportiere ich die Untertitel zum Beispiel als SRT-Datei. Diese Datei kann an Übersetzer:innen weitergegeben und in CAT-Tools weiterbearbeitet werden. Anschließend wird die übersetzte Datei wieder importiert, geprüft und feinjustiert.

Das klingt aufwendiger als ein schneller Klick in einer Social-Media-App. Ist es auch. Aber genau darin liegt der Unterschied zwischen automatisch erzeugten Captions und einem professionellen Untertitelungsworkflow. Es geht nicht nur darum, Text unter ein Video zu setzen. Es geht darum, gesprochene Sprache verständlich, korrekt, lesbar und nutzbar zu machen — gegebenenfalls in mehreren Sprachen und für unterschiedliche Zielgruppen.

Automatische Untertitel sind ein Anfang — aber keine fertige Barrierefreiheit

Viele Menschen denken bei Barrierefreiheit noch immer zuerst an Rollstühle, Rampen und abgesenkte Bordsteine. Doch auch in der digitalen Welt gibt es Barrieren. Videos ohne Untertitel sind für gehörlose Menschen nicht zugänglich. Aber auch schlechte Untertitel können zur Barriere werden.

Wenn Untertitel zu schnell eingeblendet werden, schlecht segmentiert sind, mitten im Satz umbrechen, keinen ausreichenden Kontrast haben oder wichtige Informationen fehlen, sind sie zwar technisch vorhanden — aber nicht wirklich hilfreich. Automatische Untertitel sind deshalb ein guter Anfang. Aber sie sind noch keine fertige Barrierefreiheit.

Für wirklich zugängliche Videos braucht es mehr als automatisch erkannten Text. Wichtig sind unter anderem lesbare Schriftgrößen, ausreichender Kontrast, sinnvolle Zeilenumbrüche, angemessene Lesegeschwindigkeit, klares Timing, Kennzeichnung von Sprecherwechseln, gegebenenfalls Hinweise auf relevante Geräusche, sprachliche Korrektheit und eine Gestaltung, die den Inhalt unterstützt statt ihn zu überlagern.

Gerade hier zeigt sich, warum Barrierefreiheit nicht erst am Ende eines Projekts beginnen sollte. Wenn Untertitel nur schnell als letzter Schritt erzeugt werden, bleiben viele Qualitätsfragen ungelöst. Wer Videos professionell produziert, sollte Untertitel deshalb von Anfang an mitdenken — als Teil des Kommunikations- und Publishing-Workflows.

Closed Captions, Open Captions und eingebrannte Untertitel

An dieser Stelle lohnt sich auch ein kurzer Blick auf die Begriffe. Open Captions sind fest ins Video eingebrannt. Sie sind immer sichtbar und können nicht ausgeschaltet werden. Closed Captions dagegen können im Videoplayer ein- oder ausgeschaltet werden, sofern die Plattform diese Funktion unterstützt.

Für Social Media werden häufig eingebrannte Untertitel verwendet, weil sie überall sichtbar sind und auch dann funktionieren, wenn Plattformen keine saubere Untertiteldatei ausspielen. Für barrierefreie und professionelle Workflows sind Closed Captions oder separate Untertiteldateien jedoch oft sinnvoller, weil sie flexibler sind. Sie können übersetzt, korrigiert, ausgetauscht oder für verschiedene Plattformen angepasst werden.

Auch hier gilt: Die richtige Lösung hängt vom Ziel ab. Ein schnelles Reel braucht einen anderen Workflow als ein Schulungsvideo, ein Kundenfilm, ein mehrsprachiger Onlinekurs oder ein barrierefreies Video für eine Website.

KI verändert nicht nur Tools, sondern auch unsere Rolle

Als ich 2022 über KI-Spracherkennung schrieb, war mein Blick noch stärker auf die Zeitersparnis gerichtet. Heute sehe ich klarer: Die eigentliche Veränderung liegt nicht darin, dass KI bestimmte Arbeitsschritte übernimmt. Die eigentliche Veränderung liegt darin, dass unsere Rolle sich verschiebt.

Wir tippen weniger manuell ab. Aber wir prüfen mehr. Wir korrigieren mehr. Wir strukturieren mehr. Wir entscheiden mehr. Und wir müssen genauer verstehen, wann ein KI-Ergebnis gut genug ist — und wann eben nicht.

Gerade in der Übersetzungs-, Publishing- und Kreativbranche wird diese Kompetenz immer wichtiger. Denn KI kann Inhalte erzeugen, transkribieren, übersetzen, zusammenfassen und gestalten. Aber sie versteht nicht automatisch Zielgruppen, Qualitätsstandards, Barrierefreiheit, Datenschutz, Tonalität oder professionelle Verantwortung. Das bleibt unsere Aufgabe.

Oder anders gesagt: KI kann Untertitel erstellen. Aber sie kann nicht entscheiden, ob diese Untertitel wirklich gut, verständlich und zugänglich sind.

Mein Fazit: KI ist eine starke Kollegin, aber keine Qualitätsgarantie

Ich arbeite gerne mit KI-Spracherkennung. Sie nimmt mir viel mühsame Vorarbeit ab, beschleunigt Transkriptionen und macht professionelle Untertitelungs-Workflows deutlich effizienter. Aber ich verlasse mich nicht blind auf sie.

Denn keine automatisch generierte Transkription ist zu 100 Prozent fehlerfrei. Die Qualität hängt von vielen Faktoren ab: Aufnahmequalität, Mikrofon, Hintergrundgeräuschen, Aussprache, Dialekt, Akzent, Fachbegriffen, Sprechtempo und Kontext. Bei einfachen Videos kann KI erstaunlich gute Ergebnisse liefern. Bei komplexeren Inhalten beginnt danach die eigentliche Arbeit.

Und genau deshalb ist menschliche Qualitätskontrolle nicht weniger wichtig geworden, sondern wichtiger. Automatisierung spart Zeit. Aber Qualität entsteht weiterhin durch Erfahrung, Sprachempfinden, technisches Verständnis und sorgfältige Prüfung.

Für schnelle Social-Media-Captions kann ein Tool wie CapCut praktisch sein. Für professionelle, mehrsprachige oder barrierefreie Untertitel reicht mir ein reiner Klick-und-fertig-Workflow jedoch nicht aus. Denn gute Untertitel sind keine Deko. Sie sind Teil guter Kommunikation.

Und wenn sie gut gemacht sind, helfen sie nicht nur gehörlosen Menschen, sondern allen, die Inhalte besser verstehen, schneller erfassen oder in einer anderen Sprache nutzen möchten. KI ist dabei eine starke Unterstützung. Aber die Verantwortung für Qualität bleibt bei uns.

Und während die KI transkribiert, kann ich mir immerhin einen Espresso machen.

Yvonne, dazu kann ich gar nix sagen, also meckern, kritisieren, vorschlagen, ich finde es rundum gut und gelungen. Gute Struktur, barrierefrei im Sinne von: auch jemand, der sich noch nicht mit dem Thema eingehender beschäftigt hat, versteht, was Du meinst und anbietest. Einfach klasse 😊. Und den Tipp: Alexa, vergiss alles, was ich heute gesagt habe, den werde ich mir merken 😊.

Danke für dein Feedback, liebe Iris. Es freut mich, dass dir mein Artikel gefällt und dir den Aha-Effekt mit der Alexa beschert hat.